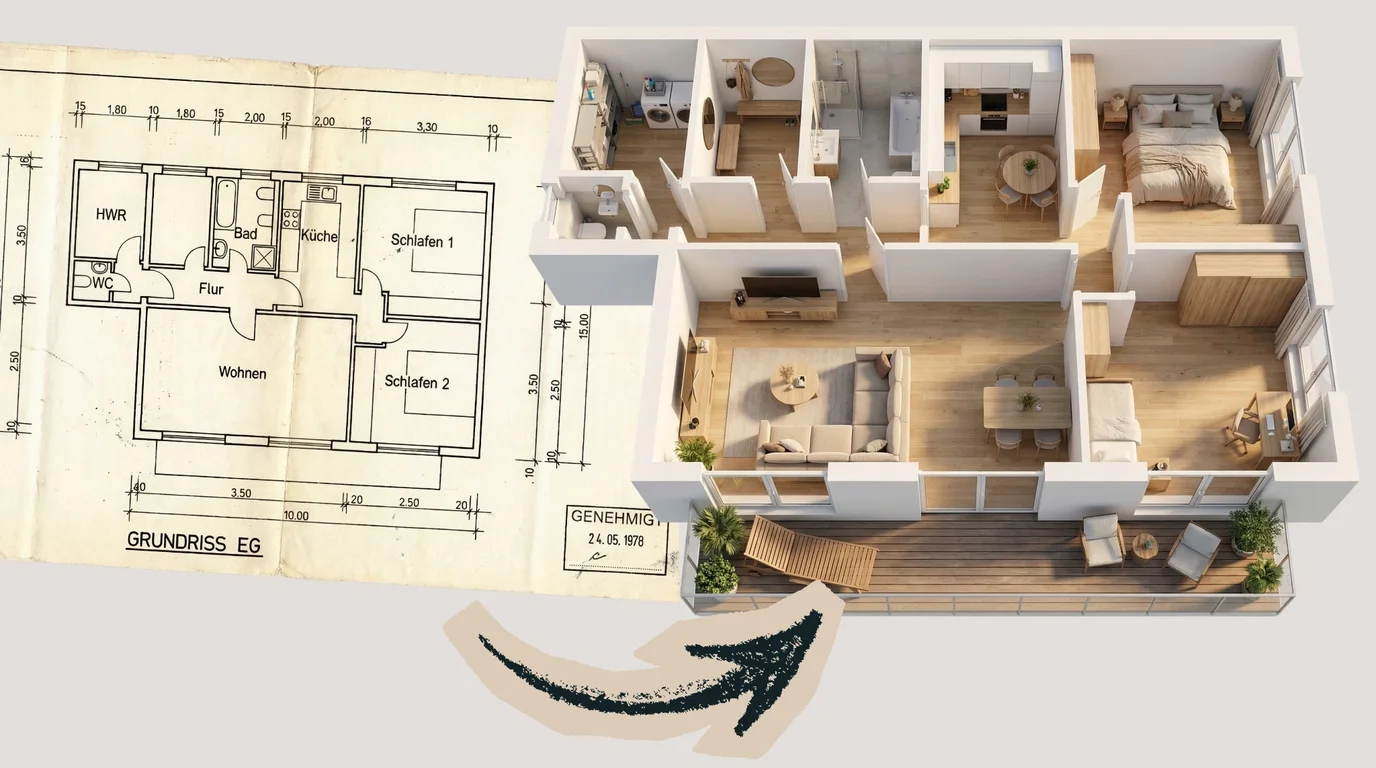

Das Problem: Grundrisse die niemand versteht

Jeder Makler kennt die Situation: Du zeigst einem Interessenten den Grundriss und siehst sofort, wie die Augen glasig werden. Linien, Symbole, Maße. Für Architekten und Bauplaner ist das Alltag. Für den normalen Menschen ist ein 2D-Grundriss etwa so hilfreich wie eine Landkarte ohne Beschriftung.

Das Problem ist nicht, dass Grundrisse schlecht gemacht sind. Das Problem ist, dass die meisten Menschen sich Räume nicht anhand von Draufsichten vorstellen können. Wie hoch ist die Decke? Wie fällt das Licht durchs Fenster? Wie fühlt sich der Raum an, wenn man drin steht? All das geht aus einem Grundriss nicht hervor.

Klassische 3D-Renderings lösen das Problem, sind aber teuer. Ein professionelles 3D-Rendering kostet zwischen 300 und 1.500 Euro pro Ansicht, je nach Detailgrad. Die Erstellung dauert Tage bis Wochen. Für ein einzelnes Prestigeobjekt lohnt sich das vielleicht. Für den normalen Immobilienalltag mit 20, 30 Objekten im Bestand? Unrealistisch.

Die Lösung: Vom flachen Plan zum räumlichen Bild

Ich habe für einen Kunden aus der Immobilienbranche ein Tool gebaut, das genau diesen Schritt automatisiert. Du lädst einen Grundriss hoch, als PDF, PNG oder JPG, und bekommst fotorealistische 3D-Ansichten der Räume zurück. Nicht in Tagen, sondern in Sekunden.

Das Spannende ist, wie die KI den Grundriss versteht. Sie erkennt nicht einfach nur Linien und Flächen. Sie versteht, welcher Raum ein Wohnzimmer ist, wo die Küche sitzt, wo Fenster und Türen sind. Auf Basis dieser Analyse generiert sie 3D-Ansichten die architektonisch Sinn ergeben. Die Möblierung passt zum Raumtyp, die Beleuchtung stimmt mit der Fensterposition überein, die Proportionen sind korrekt.

Dabei ist der Input bewusst niedrigschwellig gehalten. Es muss kein perfekter digitaler Grundriss sein. Auch ein schief abfotografierter Plan oder ein alter Scan funktioniert. Das System korrigiert Rotation, verbessert den Kontrast und extrahiert die relevanten Informationen auch aus nicht perfektem Ausgangsmaterial.

Wie das in der Praxis funktioniert

Ein typischer Ablauf: Der Makler bekommt vom Eigentümer den Grundriss als PDF. Er öffnet die Plattform, lädt den Grundriss hoch und wählt den Stil, modern, skandinavisch, klassisch. Nach wenigen Sekunden hat er 3D-Ansichten der einzelnen Räume.

Diese Bilder kann er direkt ins Exposé einbauen. Der Interessent sieht nicht mehr nur Linien auf Papier, sondern bekommt ein Gefühl für die Räume. „Ah, das Wohnzimmer ist schön groß und hell, die Küche hat einen offenen Durchgang zum Essbereich." Das sind Dinge die man aus einem 2D-Grundriss einfach nicht rausliest.

Besonders bei Neubauprojekten und Objekten die noch im Bau sind, ist das Gold wert. Die Wohnung existiert physisch noch nicht, es gibt nur Pläne. Mit den 3D-Visualisierungen kann der Makler trotzdem zeigen, wie es aussehen wird. Das verkürzt die Vermarktungszeit erheblich, weil Interessenten sich viel schneller entscheiden können.

Was sich dadurch verändert

Die Makler berichten, dass Exposés mit 3D-Visualisierungen deutlich mehr Anfragen generieren als solche mit reinen Grundrissen. Das ist logisch: Menschen reagieren auf Bilder, nicht auf technische Zeichnungen. Wenn ich sehe, wie ein Raum aussieht, entsteht eine emotionale Verbindung. Bei einem Grundriss passiert das nicht.

Bei Neubauprojekten fällt der Effekt noch stärker aus. Hier gibt es oft nur den Grundriss und vielleicht eine Außenansicht vom Architekten. Die KI-generierten Innenansichten füllen eine Lücke, die vorher entweder teuer gefüllt werden musste oder gar nicht. Interessenten können sich vorstellen, wie ihre zukünftige Wohnung aussehen wird, noch bevor der Estrich gegossen ist.

Und der Kostenfaktor: Statt Hunderte Euro pro Rendering zahlt der Makler einen Bruchteil davon und bekommt die Ergebnisse sofort. Das macht 3D-Visualisierungen auch für Mietwohnungen und kleinere Objekte wirtschaftlich, wo sie bisher einfach zu teuer waren.

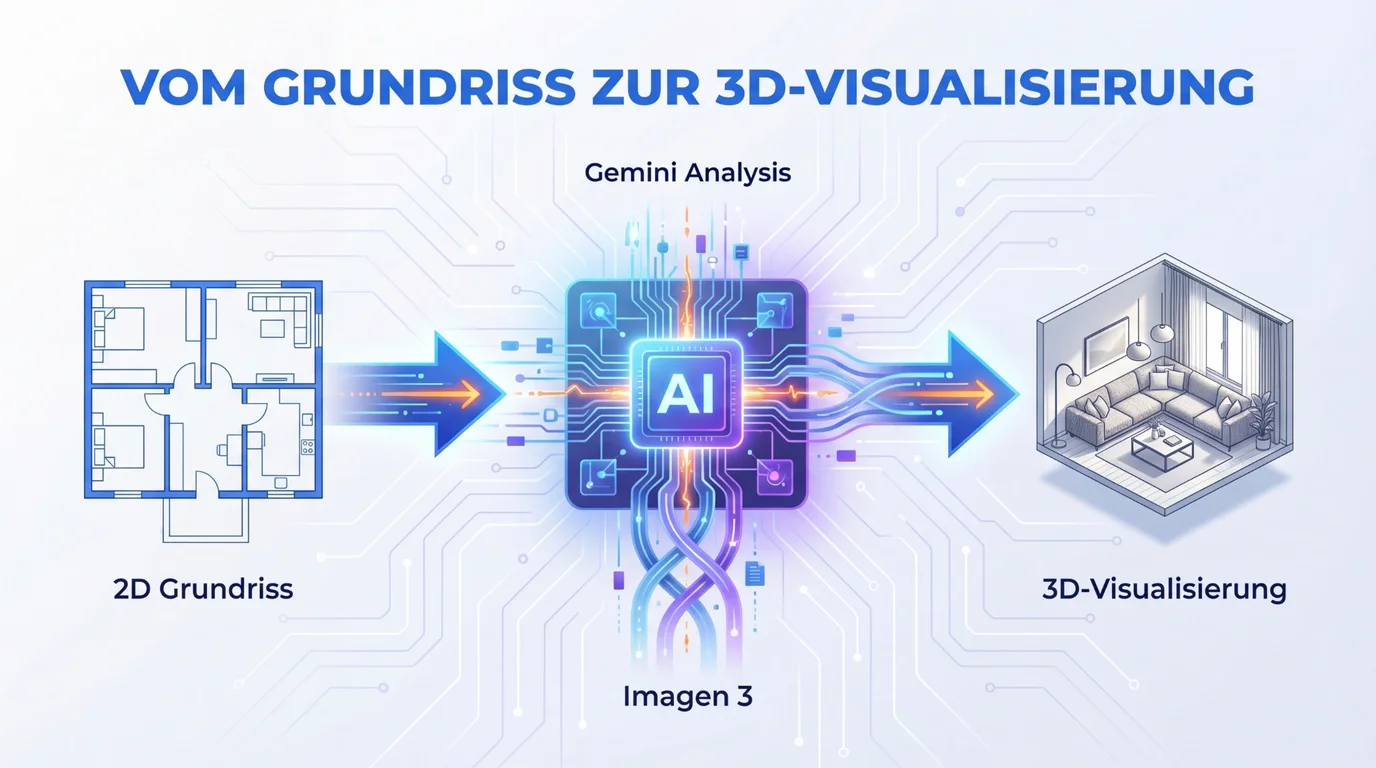

Wie funktioniert das technisch?

Jetzt kommt der technische Deep-Dive. Wer nur den Business-Case mitnehmen wollte, kann direkt zum Fazit springen.

Der Prozess läuft als Temporal-Workflow, der mehrere Schritte orchestriert. Temporal ist eine Workflow-Engine die dafür sorgt, dass auch langlebige, fehleranfällige Prozesse zuverlässig durchlaufen. Wenn ein Schritt fehlschlägt, wird er automatisch wiederholt, ohne dass der gesamte Prozess von vorne anfangen muss.

Im ersten Schritt wird das hochgeladene Bild vorverarbeitet. OpenCV übernimmt die Bildkorrektur: Rotation erkennen und korrigieren, Kontrast optimieren, Rauschen reduzieren. Das ist wichtig, weil viele Grundrisse nicht perfekt gescannt sind. Ein schief gehaltenes Handy-Foto muss genauso funktionieren wie ein sauberer PDF-Export.

Dann analysiert Google Gemini den Grundriss. Gemini versteht als Vision-Modell die räumliche Struktur: Welche Räume gibt es, wo sind Fenster und Türen positioniert, wie sind die Proportionen. Diese Analyse wird als strukturierter JSON-Output an den nächsten Schritt weitergegeben.

Im dritten Schritt übernimmt Google Imagen 3 die eigentliche 3D-Generierung. Auf Basis der Gemini-Analyse und des Originalgrundrisses erzeugt Imagen fotorealistische 3D-Ansichten. Die Prompts werden dabei dynamisch zusammengebaut: Raumtyp, Lichtverhältnisse, Stil und Möblierung fließen alle ein.

Das Frontend ist als PWA mit Nuxt 4 und TypeScript gebaut, das Backend läuft auf Laravel 12 mit PHP 8.3. Die KI-Worker sind in Python 3.12 implementiert und kommunizieren über Temporal mit dem Backend. Der Storage läuft über Hetzner S3-kompatiblen Object Storage in der EU. Kundendaten und Datenbank liegen vollständig in Deutschland. Für die KI-Generierung werden Bilddaten verschlüsselt an Google (Gemini, Imagen 3) übermittelt, dort aber nicht gespeichert oder zum Training verwendet.

Ein technisches Detail das ich spannend finde: Die Qualität der 3D-Generierung hängt stark von der Qualität der Gemini-Analyse ab. Wenn Gemini die Raumstruktur falsch interpretiert, generiert Imagen auch ein falsches Bild. Deshalb habe ich viel Zeit in die Prompt-Optimierung für die Gemini-Analyse gesteckt. Das Modell bekommt sehr detaillierte Anweisungen, worauf es achten soll: Fensterposition relativ zur Himmelsrichtung (für korrekten Lichteinfall), Wandstärken (um tragende Wände zu erkennen), Türöffnungsrichtungen (für die Möbelplatzierung). Je besser die Analyse, desto realistischer das Ergebnis.

Fazit

3D-Visualisierungen aus Grundrissen waren bisher ein Luxus, den sich nur teure Projekte leisten konnten. Mit KI wird das zur Standardfunktion. Ein Grundriss rein, fotorealistische Bilder raus. Für Makler bedeutet das: bessere Exposés, schnellere Vermarktung, weniger Kosten. Für Interessenten: endlich verstehen, wie die Wohnung wirklich aussieht.

Die Technik entwickelt sich hier rasant weiter. Was heute schon möglich ist, waren vor zwei Jahren noch Forschungsprojekte. Und die Qualität wird mit jeder neuen Modellversion besser. Wer jetzt einsteigt, hat einen echten Vorsprung.