Das Problem: Wissen ist da, aber keiner findet es

In den meisten Unternehmen existiert ein riesiger Berg an Wissen. Anleitungen, Protokolle, Schulungsvideos, E-Mails, Confluence-Seiten, irgendwo abgelegte PDFs. Das Wissen ist da. Aber frag mal einen neuen Mitarbeiter, wo er die Anleitung für den Reklamationsprozess findet. Oder frag jemanden aus dem Vertrieb, was genau im letzten Quartals-Meeting zur neuen Preisstrategie gesagt wurde.

Was passiert dann? Der Neue fragt drei Kollegen, die alle etwas anderes sagen. Oder er durchsucht das Intranet und bekommt 47 Treffer, von denen keiner wirklich passt, weil die Volltextsuche nach Stichwörtern sucht und nicht nach Bedeutung. Die Antwort steht wahrscheinlich in einem Dokument von 2024, aber das findet niemand, weil der Titel „Prozessupdate Q3" heißt und nicht „Reklamation".

Das kostet richtig Zeit. Studien zeigen, dass Wissensarbeiter im Schnitt 20 Prozent ihrer Arbeitszeit mit der Suche nach Informationen verbringen. Bei einem Team von 20 Leuten sind das vier Vollzeitstellen, die den ganzen Tag suchen statt arbeiten. Und das Schlimmste: Wenn Leute das Unternehmen verlassen, geht ihr Wissen mit. Alles was nur in ihrem Kopf war, ist weg.

Die Lösung: Ein KI-Agent, der dein Firmenwissen versteht

Ich habe für genau dieses Problem ein System gebaut, das Firmenwissen wirklich durchsuchbar macht. Nicht mit Stichwortsuche, sondern mit semantischer Suche. Das heißt: Du fragst in normaler Sprache, und das System versteht, was du meinst.

Stell dir vor, du tippst in einen Chat: „Wie läuft bei uns der Reklamationsprozess?" Und der Agent antwortet dir in wenigen Sekunden, zitiert die relevanten Dokumente und zeigt dir genau, wo die Infos herkommen. Keine Stichwortsuche, kein Scrollen durch Suchergebnisse. Eine klare Antwort mit Quellenangabe.

Das System kann Dokumente aus verschiedensten Quellen verarbeiten. PDFs, Webseiten, Videos mit automatischer Transkription, Artikel, sogar Inhalte von Plattformen wie YouTube oder LinkedIn. Alles wird analysiert, zusammengefasst und in einen durchsuchbaren Wissensspeicher überführt.

Dabei gibt es zwei Modi. Im Chat-Modus sucht das System in der Wissensdatenbank und gibt dir eine direkte Antwort auf Basis der gefundenen Dokumente. Im Agent-Modus geht es weiter: Hier kann die KI eigenständig entscheiden, ob sie im internen Wissen sucht, zusätzlich im Internet recherchiert, sich Details zu einem bestimmten Dokument holt oder sogar Notizen zu einem Eintrag hinzufügt. Der Agent denkt mit und nutzt die Werkzeuge, die ihm zur Verfügung stehen.

Wie das im Arbeitsalltag aussieht

Montagmorgen, ein neuer Mitarbeiter startet im Kundenservice. Statt drei Tage lang Kollegen zu löchern und sich durch Ordnerstrukturen zu kämpfen, öffnet er den Chat und fragt: „Was sind unsere Rückgabebedingungen für Geschäftskunden?" Er bekommt eine präzise Antwort mit Link zum Originaldokument. In 10 Sekunden statt 20 Minuten.

Oder die Vertriebsleiterin bereitet sich auf ein Meeting vor. Sie erinnert sich vage, dass es ein Schulungsvideo zur neuen Preisstaffel gab, weiß aber nicht mehr wo. Sie fragt den Agent: „Was wurde in der Schulung zur Preisstaffel 2026 erklärt?" Der Agent findet das Video, zeigt die automatisch erstellte Zusammenfassung und die wichtigsten Punkte. Ohne dass irgendjemand manuell eine Zusammenfassung geschrieben hätte.

Ein anderer Fall: Die Geschäftsführung will wissen, welche Prozesse in den letzten sechs Monaten geändert wurden. Statt jemanden drei Tage damit zu beauftragen, alle Dokumente durchzugehen, stellt man dem Agent die Frage. Er durchsucht die Wissensdatenbank, findet die relevanten Änderungsdokumente und fasst sie zusammen. In Minuten statt Tagen.

Was sich verändert hat

Das Feedback ist ziemlich eindeutig. Die Einarbeitung neuer Mitarbeiter geht deutlich schneller. Statt wochenlang im Nebel zu stochern, finden sie sofort Antworten auf ihre Fragen. Die ersten Tage fühlen sich nicht mehr an wie „Ich weiß nicht, wen ich fragen soll", sondern wie „Ich hab direkt Zugang zu allem was ich brauche".

Meetings werden effizienter, weil keiner mehr sagt: „Ich glaube, das stand irgendwo, ich schick dir das nachher." Stattdessen wird in Echtzeit nachgeschaut. Eine Frage kommt auf, der Agent wird gefragt, die Antwort ist da. Das spart nicht nur Zeit, sondern verhindert auch Fehlentscheidungen die auf Halbwissen basieren.

Und der vielleicht wichtigste Punkt: Wissen bleibt im Unternehmen. Wenn ein Mitarbeiter geht, sind seine Dokumente, seine Protokolle, seine Trainingsvideos immer noch da und immer noch durchsuchbar. Das Wissen geht nicht verloren, es bleibt zugänglich.

Wie funktioniert das technisch?

Jetzt wird es etwas technischer. Wer nur den Business-Nutzen mitnehmen wollte, kann direkt zum Fazit springen. Für alle anderen, hier der Blick unter die Haube.

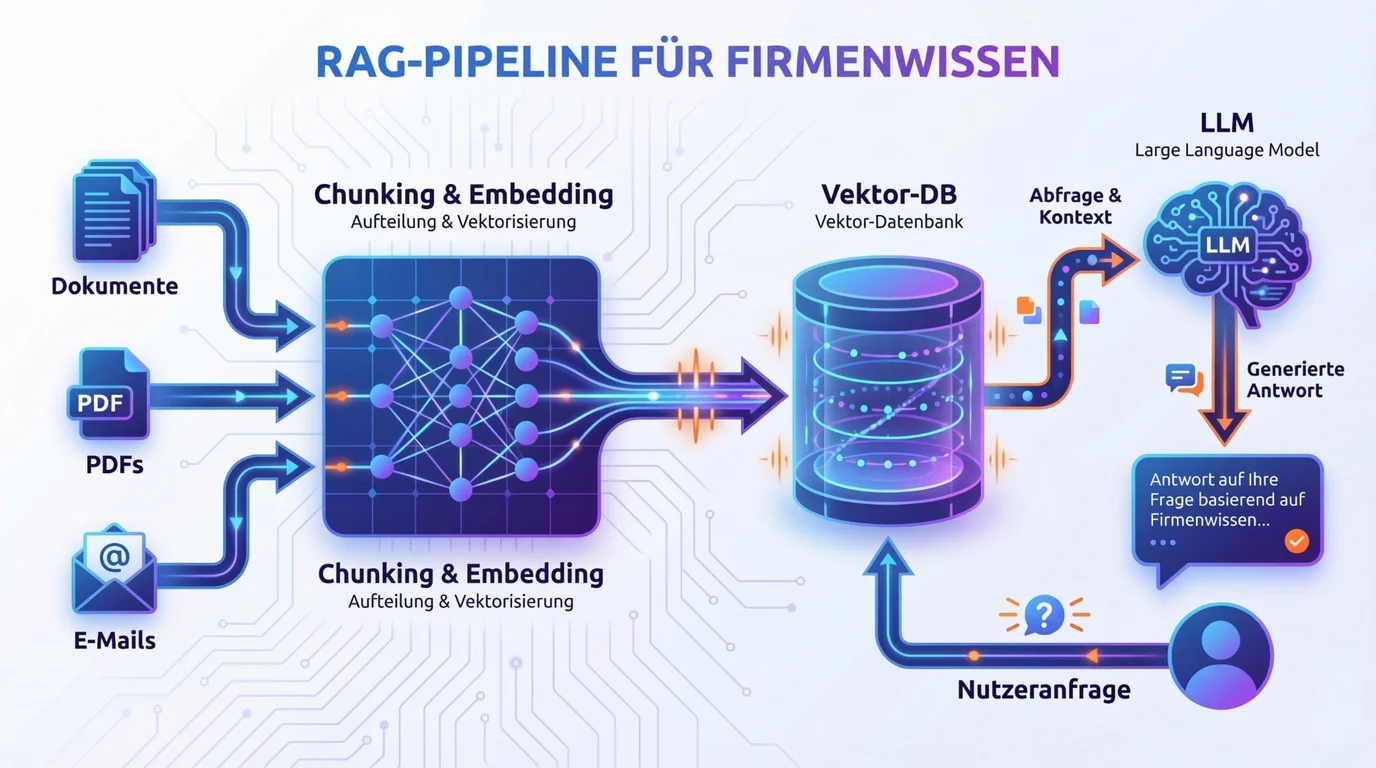

Das Herzstück ist eine RAG-Architektur (Retrieval-Augmented Generation). RAG bedeutet: Die KI erfindet nichts, sondern sucht zuerst in den vorhandenen Dokumenten und generiert dann eine Antwort auf Basis dessen, was sie gefunden hat. Das reduziert Halluzinationen massiv und macht jede Antwort nachprüfbar.

Die Dokumente werden beim Import analysiert und in sogenannte Embeddings umgewandelt. Dabei nutze ich Mistral Embeddings mit 1024 Dimensionen. Ein Embedding ist im Grunde eine mathematische Repräsentation der Bedeutung eines Texts. Zwei Texte die inhaltlich ähnlich sind, haben ähnliche Embeddings, auch wenn sie komplett andere Wörter verwenden. Genau das macht die semantische Suche so mächtig.

Diese Embeddings werden in PostgreSQL mit der pgvector-Erweiterung gespeichert. pgvector ermöglicht eine sogenannte Vektorsuche direkt in der Datenbank. Dafür nutze ich einen HNSW-Index (Hierarchical Navigable Small World), der Suchanfragen in unter 100 Millisekunden beantwortet, auch bei tausenden von Dokumenten. Dazu kommt eine klassische Volltextsuche auf Deutsch, sodass Hybrid Search möglich ist: Bedeutung plus exakte Begriffe.

Für den Agent-Modus setze ich auf Claude mit Tool Use. Claude bekommt vier Werkzeuge zur Verfügung: eine semantische Suche in der Wissensdatenbank, eine Websuche für aktuelle Informationen, eine Detailansicht um komplette Dokumente zu laden, und die Möglichkeit Notizen zu Einträgen hinzuzufügen. Claude entscheidet selbstständig, welche Werkzeuge er in welcher Reihenfolge nutzt. Pro Anfrage sind bis zu 8 Iterationen möglich, sodass der Agent auch komplexe Fragen beantworten kann, die mehrere Suchschritte erfordern.

Das Admin-Interface läuft auf Laravel 12 mit Filament v5. Darüber werden Dokumente verwaltet, Kategorien gepflegt, Kollektionen erstellt und der Chat genutzt. Der Media Processor ist ein separater Python-Service auf Basis von FastAPI, der sich um Downloads, Transkriptionen (über Mistral Voxtral) und das Embedding-Management kümmert. Die Kommunikation zwischen den Services läuft asynchron.

Ein Detail das ich bewusst anders gemacht habe als viele RAG-Implementierungen: Ich arbeite mit Embeddings auf Dokumentebene statt mit kleinteiligem Chunking. Der Embedding-Text wird aus Titel, Zusammenfassung und Kernaussagen zusammengesetzt. Das hat den Vorteil, dass die Suche ganze Dokumente findet statt isolierte Textfragmente. Der Kontext bleibt erhalten, und der Agent kann bei Bedarf das vollständige Dokument nachladen.

Die gesamte Infrastruktur ist mit Docker containerisiert und läuft auf Hetzner Cloud in Deutschland. Deployment über Gitea Actions mit automatischen Builds. Kundendaten, Datenbank und Vektorspeicher liegen vollständig in der EU. Für die KI-Verarbeitung werden Anfragen verschlüsselt an die jeweiligen API-Anbieter (Anthropic, Mistral) übermittelt, dort aber nicht gespeichert oder zum Training verwendet.

Fazit

Wissen ist in den meisten Unternehmen das wertvollste Asset. Aber nur wenn man es findet. RAG mit semantischer Suche und einem KI-Agent verändert grundlegend, wie Teams auf ihr Wissen zugreifen. Statt suchen, fragen. Statt scrollen, verstehen. Statt Halbwissen, Quellenangaben.

Das Schöne daran: Für den Nutzer fühlt es sich an wie ein normaler Chat. Die ganze Komplexität mit Embeddings, Vektorsuche und Tool Use passiert im Hintergrund. Man tippt eine Frage und bekommt eine fundierte Antwort. So einfach sollte Wissensmanagement sein.